Das ist der dritte Teil eines Essays zur Verbindung des humanistischen Bildungsideals und Social Media.

* * *

Bevor es Schachcomputer gab, waren Menschen von der Idee besessen, dass eine Maschine besser Schach spielen könne als ein Mensch. Etwas mehr als 200 Jahre nachdem der Schachtürke, eine Maschine, die von einem Menschen bedient wurde, zum ersten Mal Schach spielte, schlug der IBM-Computer Deep Blue den Schachweltmeister Garry Kasparov in einem Turnier. Seither haben nicht nur die Computer, sondern vor allem die Algorithmen starke Fortschritte gemacht: Auf jedem Handy lässt sich eine Software installieren, die zu den stärksten Schachspielern der Welt gehören würde, dürfte sie an den Turnieren teilnehmen.

Schach, so könnte man sagen, war lange ein Abgrenzungskriterium zwischen Mensch und Maschine: Maschinen können viel, aber nicht Schach spielen. Und so lange sie das nicht können, braucht der Mensch keine Angst davor zu haben, den Maschinen nicht mehr überlegen zu sein.

Ein etwas feineres Kriterium formulierte der Mathematiker Alan Turing 1950: Der nach ihm benannte Turing-Test besagt, dass Maschinen oder Computer dann als intelligent gelten können, wenn ein Mensch nicht in der Lage ist, in einem Chat mit einem menschlichen und einem maschinellen Partner zu bestimmen, was von einem Menschen getippt wurde und was von einem Computer.

Gegen diesen Test gibt es eine Reihe von Einwänden – der spannendste stammt wohl von John Searle, der im Chinese-Room-Experiment vorgeschlagen hat, sich einen Raum vorzustellen, in dem ein Mensch sitzt, der kein Chinesisch spricht, aber mit Hilfe eines Buches chinesische Botschaften, die unter der Tür durchgeschoben werden, problemlos beantworten kann. Der Mensch kann deswegen kein Chinesisch – und ein Computer deshalb auch weder eine natürliche Sprache sprechen noch denken.

Die Frage, ob Computer denken können oder gar ein Bewusstsein entwickeln werden, kann nicht so einfach beantwortet werden, wie das Searle vorgibt. Selbstlernende Algorithmen – wie sie z.B. Google einsetzt – erledigen Aufgaben, für die sie nicht spezifisch programmiert worden sind. Gängige Vorstellungen der Funktionsweise von Computern prallen daran ab.

Was hat das mit humanistischer Bildung und Social Media zu tun? Social Media führen dazu, dass menschliche Kommunikation medialisiert abläuft. Zwischen zwei Menschen treten jeweils ein Interface, das sie bedienen müssen, um einander indirekt wahrnehmen zu können. Aufgrund unser Lebens- und Arbeitsverhältnisse nutzen wir solche Kommunikationsformen immer häufiger: Kinder sprechen mit ihren abwesenden Eltern über Skype, Mitarbeitende organisieren sich über Länder und Kontinente hinweg. Das gilt auch für die Bildung.

Während Schulbücher Wissen schon immer medialisiert zugänglich gemacht haben, war der Unterricht meist auf direkten Kontakt hin angelegt. Menschen bilden sich mit anderen Menschen zusammen. Neu treten nicht nur Geräte zwischen die Menschen, sondern es wird zunehmend unsicher, ob am anderen Ende überhaupt noch ein Mensch ist oder ein Computer. So schrecklich die Vorstellung erscheinen mag, dass Algorithmen in die Rolle von Lehrpersonen oder gar Schülerinnen und Schüler schlüpfen: Sie ist nicht in der fernen Zukunft zu suchen. Bereits heute gibt es Computerprogramme, die bestimmte Mathematikaufgaben effizienter vermitteln können als menschliche Coaches. Zudem verwenden wir Menschen auch immer mehr Algorithmen, die unsere Arbeit vereinfachen.

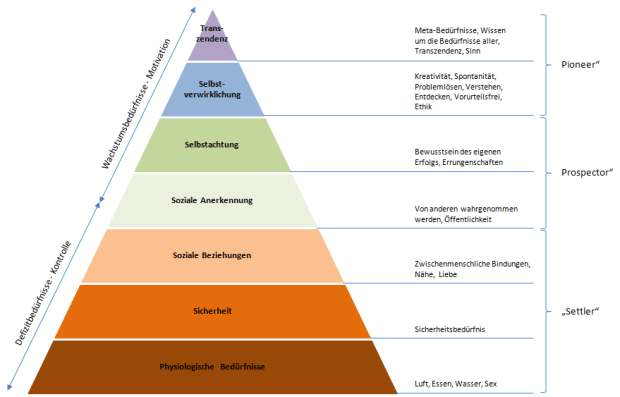

Wenn nun der Humanist Humboldt fordert, Bildung habe den Zweck, dass der Mensch mit seiner »Einzigartigkeit die Menschheit bereichere«, dann wird das immer mehr fraglich. Menschliche Äußerungen dienen im Internet riesigen Algorithmen dazu, Wissen effizienter verarbeiten zu können. Die entscheidende Frage wird in der Zukunft sein, ob Menschen Maschinen nutzen oder Maschinen Menschen. Die besten Schachpartien spielen heute Spielerinnen und Spieler, die darin geübt sind, mit einem Computer zu interagieren. Sie teilen sich die schwierige Aufgabe des Spiels mit einem Automaten – es lässt sich nicht mehr genau bestimmen, wer wichtiger ist.

In seinem Buch Gadget macht Jaron Lanier eine feinsinnige Anmerkung zum Turing-Test. Er messe zwei Dinge gleichzeitig: Das Verhalten der Chatpartner – aber auch die Anforderung, welche die Versuchsperson an menschliches Verhalten stellt. Diese Anforderungen würden zunehmend sinken, befürchtet Lanier. Wenn z.B. schulische Leistungen nur noch in Bezug auf standardisierte Tests, also Algorithmen, gemessen werden, dann wird menschliches Verhalten bald so beurteilt, wie man die Leistung von Computern einschätzt.

Social Media könnte also dazu führen, dass wir mit Menschen ähnlich kommunizieren wie mit Computern. Unser Verhältnis zu Maschinen wird die große Herausforderung der nächsten zehn bis 50 Jahre sein. Hierfür ist das humanistische Bildungsideal ein wichtiger Orientierungspunkt, gerade auch für die vielen ethischen Fragen, die der Umgang mit immer autonomeren Maschinen mit sich bringen wird (wer ist für ihr Handeln verantwortlich, wie dürfen wir sie behandeln?).